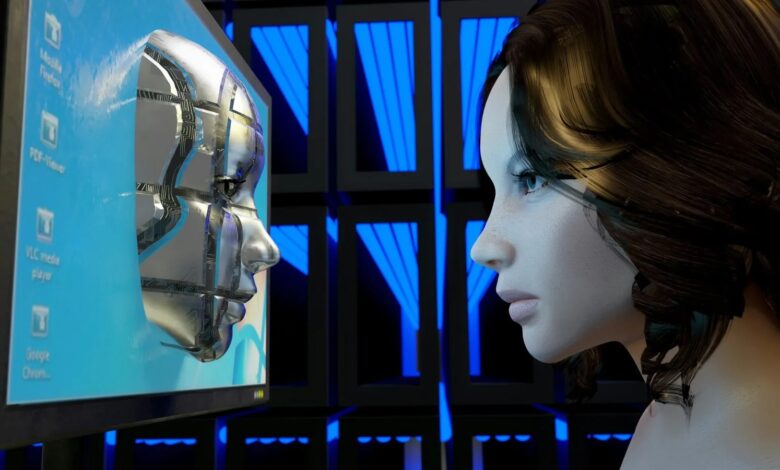

Especialistas alertam que vídeos hiper-realistas criados por inteligência artificial desafiam a verificação da informação e exigem novos cuidados do público

O avanço acelerado das ferramentas de inteligência artificial (IA) mudou radicalmente a forma como imagens e vídeos são produzidos, consumidos e compartilhados. Se antes montagens digitais eram relativamente fáceis de identificar, hoje vídeos hiper-realistas criados por IA desafiam até usuários experientes — incluindo jovens que cresceram imersos no ambiente digital.

A sofisticação dessas tecnologias levanta uma questão central: ainda é possível diferenciar um vídeo real de um conteúdo gerado por IA? Para especialistas em tecnologia e comunicação, a resposta é cada vez mais complexa.

Ferramentas capazes de simular expressões faciais, movimentos corporais, entonação de voz e até emoções humanas tornaram os chamados deepfakes extremamente convincentes. Em muitos casos, o material falso só pode ser identificado com auxílio técnico ou análise especializada.

Quando o olhar humano já não é suficiente

Pesquisadores explicam que o cérebro humano tende a confiar em estímulos visuais e auditivos coerentes. A IA explora exatamente esse mecanismo, reproduzindo padrões naturais de fala, iluminação, sombras e gestos. O resultado são vídeos que parecem autênticos mesmo quando apresentam cenas ou declarações que nunca existiram.

“Hoje, não basta mais confiar apenas na intuição. O nível de realismo atingiu um ponto em que o erro humano é esperado”, apontam especialistas em verificação digital.

Esse cenário amplia os riscos de desinformação, golpes financeiros, manipulação política e danos à reputação de pessoas públicas e anônimas.

Sinais de alerta ainda ajudam — mas não garantem

Apesar da evolução tecnológica, alguns indícios podem levantar suspeitas:

- Movimentos faciais rígidos ou levemente atrasados

- Olhos piscando de forma incomum

- Sincronização imperfeita entre fala e boca

- Iluminação incoerente ao longo do vídeo

No entanto, especialistas alertam que esses sinais estão se tornando cada vez mais sutis. As versões mais recentes de IA já corrigem muitos desses “defeitos”, tornando a detecção manual menos confiável.

Tecnologia contra tecnologia

Para enfrentar o problema, empresas e pesquisadores desenvolvem ferramentas baseadas em IA de detecção, capazes de identificar padrões invisíveis ao olho humano. Além disso, cresce o uso de marcação digital de conteúdo, que permite rastrear a origem de vídeos e imagens.

Plataformas digitais também começam a adotar políticas mais rígidas de rotulagem de conteúdos sintéticos, embora a aplicação ainda seja desigual e limitada.

Educação digital vira prioridade

Diante desse novo cenário, especialistas defendem que a educação midiática se torne parte essencial da formação da população. A recomendação é sempre desconfiar de conteúdos sensacionalistas, verificar a fonte, buscar confirmação em veículos confiáveis e evitar o compartilhamento impulsivo.

“Não estamos vivendo apenas uma revolução tecnológica, mas uma crise de confiança visual. Aprender a questionar o que vemos é uma habilidade fundamental do nosso tempo”, avaliam analistas.

Em um mundo onde a imagem já não é prova absoluta da realidade, a combinação entre senso crítico, informação de qualidade e ferramentas de verificação passa a ser o principal antídoto contra a manipulação digital.